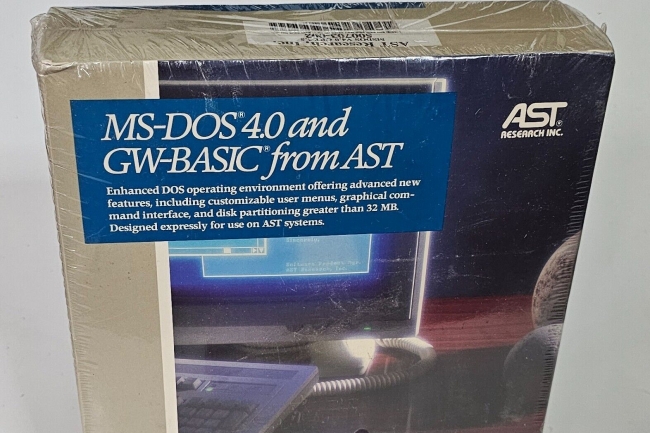

- MS-DOS 4.0 publicado en Github. La semana pasadaMicrosoft ha anunciado la transición a código abierto (bajo licencia MIT) de Su famoso sistema operativo MS-DOS 4.0 en GithubOriginalmente desarrollado en colaboración con IBM y escrito en ensamblador 8086 hace casi 45 años, MS-DOS 4.0 llegó curiosamente entre las versiones 3 y 3.1 de (Sistema operativo de disco de Microsoft). Sin embargo, aclaremos que algunas fuentes explican -tras inspeccionar el código- que no se trataría realmente del código fuente de MS-DOS 4.0, sino más bien del 4.01 o PC-DOS 4.01. Presentado en 1986, MS-DOS 4.0 estaba disponible en varias versiones, entre ellas el interesantísimo Multitasking DOS, similar al clon Wendin-DOS. Lamentablemente, la parte publicada por Microsoft no contiene el código de esta versión multitarea. Los más curiosos pueden hacer una reaparición muy instructiva utilizando un emulador gratuito como PCem y 86box. No es la primera vez que Microsoft publica el código de uno de los sistemas operativos: hace 10 años, el editor ya había transmitido y compartido con el Computer History Museum los códigos fuente de MS-DOS 1.25 y 2.0.

- Otra denuncia más contra OpenAI en virtud del RGPDEl grupo Noyb, dirigido por Max Schrems, presentó una denuncia ante la CNIL austriaca contra OpenAI La asociación denuncia que el servicio ChatGPT viola las normas del reglamento europeo. La asociación considera que la información no se puede corregir si se considera inexacta. En su denuncia, muestra una alucinación sobre la fecha de nacimiento de Max Schrems sin tener la posibilidad de modificarla o eliminarla. OpenAI consideró que la operación era imposible y reiteró el argumento denegando el acceso a los datos que le conciernen y a las fuentes de información. Sin embargo, el RGPD especifica en su artículo 5 el principio de exactitud de los datos "completos y actualizados" y que, si los datos personales son inexactos, deben eliminarse o rectificarse sin demora.

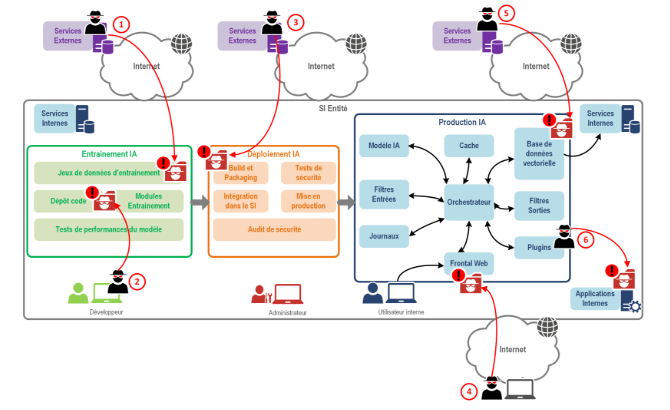

- Anssi analiza la seguridad de la IA generativaLos equipos de Vincent Strubel acaban de publicar una guía para “Recomendaciones de seguridad para un sistema de IA generativa ». Se prestará especial atención a las tres fases del ciclo de vida de GenAI: entrenamiento, despliegue y producción. Señala varios tipos de ataques: manipulación, infección, exfiltración, etc. Para la agencia, es imperativo realizar un análisis de riesgos sobre los sistemas de IA antes de la fase de entrenamiento en torno a diferentes puntos como la evaluación del nivel de confianza de las bibliotecas y las fuentes de datos externas. En las recomendaciones, Anssi se suma a la Cnil (que publicó recientemente fichas prácticas) sobre la confidencialidad de los datos que hay que tener en cuenta desde el diseño del sistema de IA. Por último, el guardián de la ciberseguridad llama especialmente la atención sobre el caso de la generación de código (con riesgo de inserción de puerta trasera), los servicios de IA de consumo expuestos en Internet y el uso de IA generativa de terceros.

Ejemplo de posibles ataques a sistemas de IA generativos. (Crédito de la foto: Anssi)

Otras noticias que te pueden interesar