Los ataques ultrasónicos del asistente de voz se perfeccionan

hace 2 años

Los ciberdelincuentes son cada vez más creativos y no dudan en atacar todos los terminales que tienen a mano. Investigadores estadounidenses han demostrado cómo se pueden usar asistentes de voz para lanzar ataques inaudibles a través de ultrasonido.

Los sistemas de reconocimiento de voz como Alexa, Cortana, Google Now o Siri se han convertido en un método cada vez más popular de interacción humano-ordenador. También se han conectado a varios sistemas controlados por voz. Quien dice popularidad, también dice mayor riesgo de ataque a través de estos dispositivos. De hecho, algunos comandos de voz ocultos, inaudibles para los usuarios, pueden usarse para controlar sistemas. Así lo demostraron varios investigadores en un estudio publicado en 2017 bajo el nombre DolphinAttack: Inaudible Voice Commands. En este trabajo, por tanto, han diseñado un ataque llamado DolphinAttack, que modula los comandos de voz en medios ultrasónicos (utilizando ultrasonidos cuya frecuencia es superior a 20 kHz) para lograr la inaudibilidad.

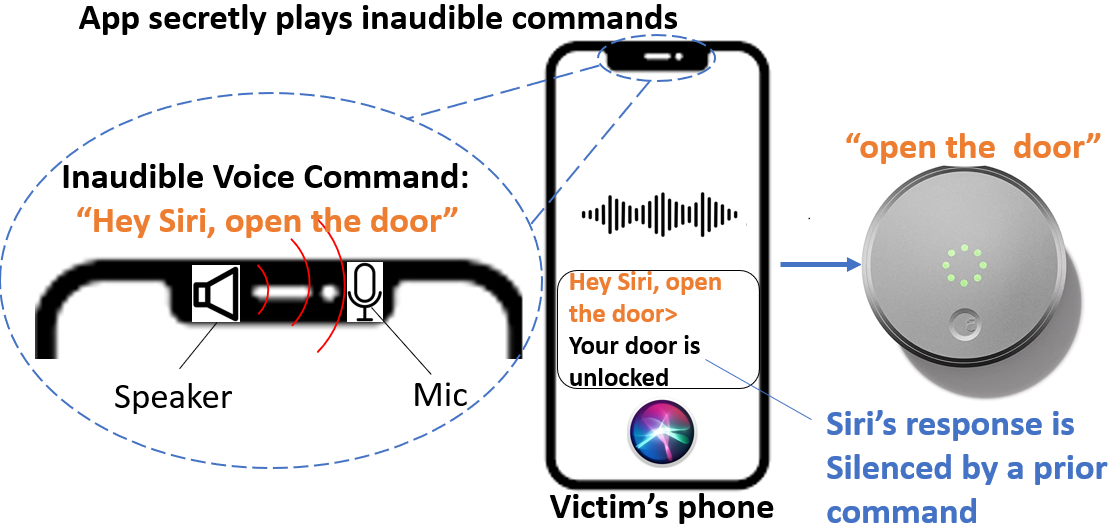

Al inyectar una secuencia de comandos de voz inaudibles en los asistentes de voz, el equipo de investigación pudo demostrar algunos ataques de demostración, que incluyen activar Siri para iniciar una llamada FaceTime en el iPhone, activar Google Now para poner el teléfono en modo avión e incluso manipular el sistema de navegación de un Audi. Para evitar el uso abusivo de DolphinAttack en la realidad, los investigadores también proponen dos soluciones de defensa, tanto de hardware como de software. Sin embargo, sugieren principalmente repensar las reglas de control para los sistemas activados por voz para que resistan los ataques ultrasónicos. La historia se repite hoy, ya que investigadores estadounidenses desarrollaron un ataque llamado troyano inaudible de ultrasonido cercano (Night) que puede lanzar una ofensiva silenciosa contra dispositivos alimentados por asistentes de voz, como teléfonos inteligentes, parlantes conectados y otros dispositivos IoT.

El IoT, un objetivo prioritario para los ciberdelincuentes

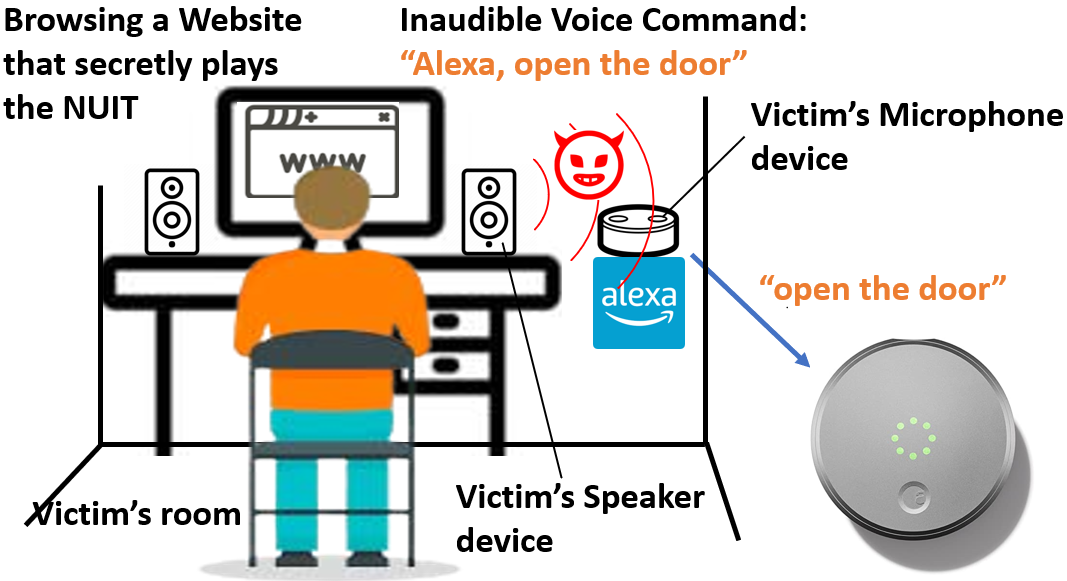

Un equipo de tres investigadores, compuesto por el profesor Guenevere Chen de la Universidad de Texas en San Antonio (UTSA), su estudiante de doctorado Qi Xia y el profesor Shouhuai Xu de la Universidad de Colorado (UCCS), demostró ataques nocturnos contra asistentes de voz encontrados en millones. de dispositivos, incluidos Siri de Apple, Asistente de Google, Cortana de Microsoft y Alexa de Amazon. Capaz de llevarse a cabo de forma remota a través de Internet, el Night Attack aparece como un clip de sonido en el rango de frecuencia casi ultrasónico (16kHz-20kHz) y se puede reproducir en el altavoz de la víctima para golpear al asistente de voz en el mismo dispositivo (Night-1) o en otros dispositivos de la víctima.

En el caso del ataque Night-2 entre dos teléfonos, el primer dispositivo funciona como dispositivo atacante o altavoz. El dispositivo 2 es el terminal de la víctima, cuyos asistentes de voz son el objetivo de los ataques Night-2.

Los investigadores compilaron una lista de ejemplos de ataques en diferentes puntos finales y con varios enfoques. Por lo tanto, Nuit se puede integrar con sitios web que reproducen medios o videos de YouTube. En este sentido, engañar a los objetivos para que visiten estos sitios o reproduzcan medios maliciosos en sitios confiables es un caso relativamente simple de ingeniería social. “Si reproduce YouTube en su televisor inteligente, este televisor inteligente tiene un altavoz, ¿verdad? El sonido de los comandos maliciosos NIGHT se volverá inaudible y también puede atacar su teléfono móvil y comunicarse con su Asistente de Google o dispositivos Alexa”, explicó el investigador Guenevere Chen. Otro punto destacado: “Incluso puede suceder en Zoom durante las reuniones”, agrega. Para protegerse contra este tipo de ataque, se recomienda enfáticamente que se autentique en cualquier dispositivo usando su huella de voz. Guenevere Chen también aconseja a los usuarios monitorear de cerca las activaciones del micrófono en las terminales, que tienen indicadores en pantalla dedicados en los teléfonos inteligentes iOS y Android. Finalmente, se deben preferir los auriculares a los altavoces. Los investigadores planean presentar su investigación sobre el ataque nocturno con más detalle en el 32º Simposio de Seguridad de USENIX programado del 9 al 11 de agosto en Anaheim, California.

Si quieres conocer otros artículos parecidos a Los ataques ultrasónicos del asistente de voz se perfeccionan puedes visitar la categoría Otros.

Otras noticias que te pueden interesar