Las promesas de un Eldorado en torno a la IA, y en particular a la IA generativa, se enfrentan al peligro de los datos personales. Las tensiones sobre este tema están creciendo hasta el punto de ser objeto de procedimientos judiciales. Es el caso de la asociación Noyb dirigida por Max Schrems (el que derrotó a Safe Harbor y Privacy Shield). que ataca a Meta con 11 CNIL europeas, incluida Francia por cambios en su política de tratamiento de datos personales para IA que no cumplen con el RGPD. De hecho, la empresa matriz de Facebook ha cambiado su política de privacidad, que entrará en vigor el 26 de junio.

Una sucesión de infracciones del RGPD para Meta

La asociación señala que Meta informa a los interesados de que sus datos se utilizarán para una “tecnología de inteligencia artificial” no definida. Por ello, solicita que se aclare el tipo de tecnología utilizada y con qué finalidad. Además, Noyb observa que casi todos los datos de las plataformas de Meta (con excepción de los mensajes privados) se pueden recopilar para entrenar modelos de IA. Se señalan otras deficiencias, como la falta de limitaciones en cuanto a la antigüedad de los datos o a la seudonimización de la información. Otro punto de fricción es el hecho de que los datos personales pueden transmitirse a terceros a través de los sistemas de IA de Meta.

La denuncia vincula otras quejas, como la imposibilidad de implementar el derecho al olvido por parte de los modelos de IA. De hecho, los actores de la IA a menudo destacan que "los datos personales que se introducen una vez en un sistema de IA no pueden (según los responsables del tratamiento) "desconocerse", "olvidarse", eliminarse o rectificarse", subraya Noyb. En este caso también es difícil ejercer la oposición al tratamiento; se acusa a Meta de haber complicado el procedimiento mediante un sistema de opt-out (validación por defecto) en lugar de un sistema de opt-in (rechazo por defecto).

Adobe en crisis tras los cambios en la CGU

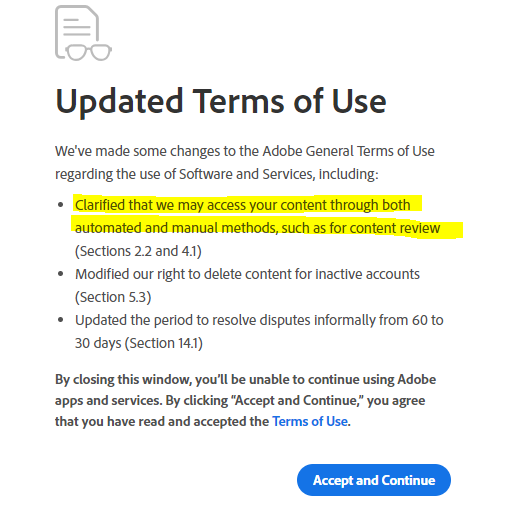

Mientras el caso de Meta en Europa se está tramitando en los tribunales, otras empresas se enfrentan a una reacción negativa por un problema similar. Adobe, por ejemplo, también enfrentó una polémica tras cambiar sus términos de uso el pasado mes de febrero, que presentó a sus clientes este mes. La actualización enfatiza el derecho de la empresa a "acceder a su contenido mediante métodos automáticos y manuales". Define "contenido" como "cualquier texto, información, comunicación o material, como archivos de audio, archivos de vídeo, documentos electrónicos o imágenes, que cargue, importe, integre para su uso o cree utilizando los Servicios y el Software".

El apartado de la CGU sobre los métodos automatizados genera polémica. (Foto: DR)

El cambio en lo que respecta a los “métodos automatizados” se refiere a los modelos de IA. Adobe, como muchos otros editores, distribuye IA generativa en sus soluciones, incluidos Reader y Acrobat para archivos PDF o Photoshop para la creación de imágenes. Y la empresa necesita datos, incluidos datos confidenciales o personales, para entrenar sus modelos y perfeccionarlos. Varios clientes han expresado su descontento en este punto: “si eres un profesional, si estás bajo un acuerdo de confidencialidad con tus clientes, si eres un creativo, un abogado, un médico o cualquiera que trabaje con archivos propietarios, es hora de dejar de lado a Adobe, que ya no es confiable”. explica sobre X, WetterSchneiderun diseñador para DC Comics y Nike. Director Duncan Jones se queja de la política de Adobe: "Oye @Photoshop, ¿cuál es este nuevo acuerdo que nos obligaste a firmar esta mañana que bloquea nuestra aplicación hasta que lo aceptemos?"

Otras noticias que te pueden interesar