Si Nvidia domina hoy el mercado de aceleradores de GPU, no es sólo gracias al desarrollo de chips cada vez más potentes. La firma de Santa Clara comprendió mucho antes que sus principales competidores (ATI, luego AMD tras la adquisición de esta empresa canadiense que dio origen a las GPU Radeon y, por supuesto, Intel) que el mercado de la computación de alto rendimiento (HPC) requería un ecosistema de software dedicado. Plataforma de computación paralela de propósito general y modelo de programación, el kit de desarrollo Cuda (Compute Unified Device Architecture) de Nvidia se lanzó en 2007 -para su GeForce 8- para ayudar a los desarrolladores a portar sus aplicaciones a sus GPU para acelerar ciertos procesamientos (compresión, finanzas, simulación de fluidos, modelado climático, descifrado de códigos o incluso cálculos estructurales). El kit de desarrollo ha experimentado muchos cambios para acompañar el lanzamiento de arquitecturas de GPU y mejorar su manejo, que se sabía que era difícil. Además, Nvidia no perdió tiempo en adoptar la tecnología Tensor desarrollada en 2015 por Google para sus aceleradores TPU. Nvidia presentó sus primeras unidades Tensor en mayo de 2017 con la microarquitectura de GPU Volta utilizada por los productos Tesla V100.

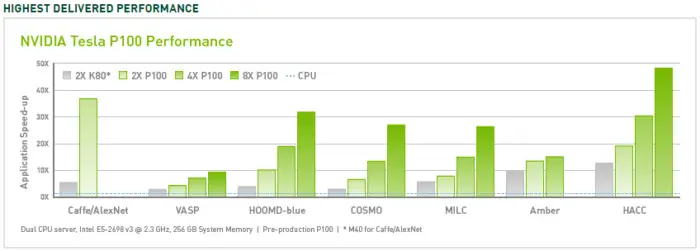

Mientras que AMD respondió tarde a Cuda con el lanzamiento de Radeon Stream, Intel presentó Larrabee y El grupo Khronos Aunque las iniciativas en torno a OpenCL (lanzadas en 2009) se han federado, la hegemonía de Nvidia sigue siendo indiscutible en un mercado impulsado por la necesidad de IA (generativa o discriminativa). Cuda ha mejorado y ampliado su alcance a lo largo de los años, más o menos en línea con sus lanzamientos de GPU. Al utilizar múltiples aceleradores P100, fue posible lograr mejoras de rendimiento hasta 50 veces mayores que las de los procesadores. El V100 seguía siendo 3 veces más rápido para ciertas cargas de trabajo (hasta 150 veces más rápido que los procesadores), y el A100 seguía siendo 2 veces más rápido (hasta 300 veces más rápido que los procesadores). La generación anterior de GPU para servidores, la K80, ofrecía un rendimiento de 5 a 12 veces mayor que el de los procesadores. Hoy, casi 4 millones de desarrolladores en todo el mundo confían en la plataforma Cuda para crear aplicaciones (con o sin IA) que aprovechan el rendimiento de las GPU.

Los avances en aceleradores de GPU de Nvidia han sido constantes en los últimos años. (Crédito: Nvidia)

Proveedores agrupados en la Fundación UXL

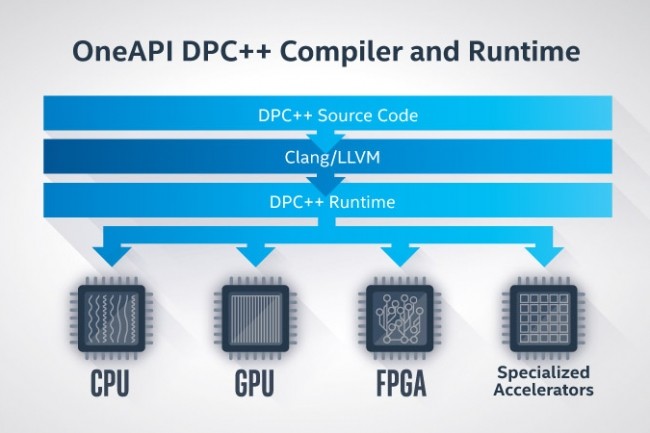

Una coalición de proveedores (Arm, Google, Imagination Technologies, Intel, Qualcomm y Samsung) agrupados en la Fundación UXL (una rama de la poderosa Linux Foundation) pretende desafiar esta dominación atacando el kit de desarrollo Cuda, que mantiene a los desarrolladores en el ecosistema de GPU de Nvidia. Desde OneAPILa Fundación UXL, que es una tecnología desarrollada por Intel, planea crear un conjunto de software y herramientas que puedan impulsar múltiples tipos de aceleradores. “Tenemos un competidor de código abierto para la plataforma Cuda de Nvidia que aprovecha aceleradores como las GPU”, publicó en X la ex ingeniera de Google Kelsey Hightower cuando se lanzó la Fundación UXL en septiembre pasado. El proyecto de código abierto tiene como objetivo ejecutar aplicaciones HPC en cualquier servidor, independientemente de la CPU y la GPU que lo alimenten.

La función SYCLomatic de OneAPI garantiza la conversión de software (IA o de otro tipo) escrito para Cuda en código SYCL capaz de ejecutarse en aceleradores de otros proveedores con una ligera pérdida de rendimiento. Vinesh Sukumar, director de inteligencia artificial y aprendizaje automático de Qualcomm, dijo a Reuters que "mostramos a los desarrolladores cómo migrar desde una plataforma Nvidia". Si bien el comité directivo técnico de la Fundación UXL planea refinar las especificaciones de su modelo de programación de IA en la primera mitad de 2024, OneAPI no es la única iniciativa contra Cuda: Start-ups como Cerebras, Crecer o SambaNova han desarrollado su propio ASIC dedicado a la IA con el software adecuado. Instalada durante más de quince años con un ecosistema especialmente provisto, la plataforma Cuda no será fácil de desmantelar, incluso Si Nvidia parece estar quedándose sin fuelle como lo demuestra el lanzamiento de sus recientes GPU B200 basadas en la arquitectura Blackwell.

Otras noticias que te pueden interesar