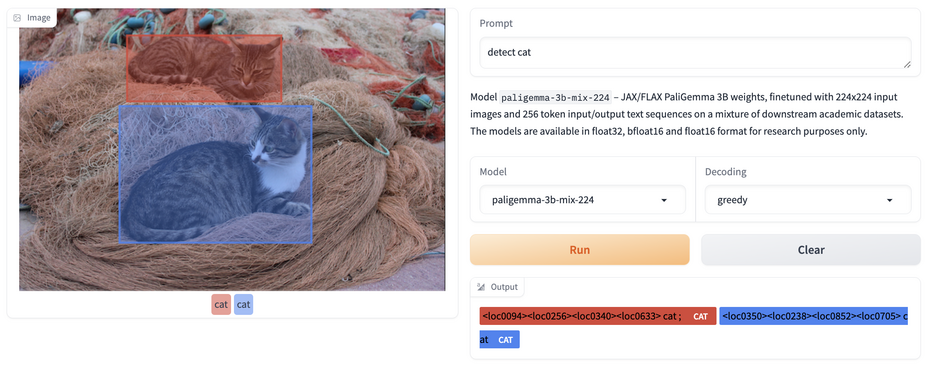

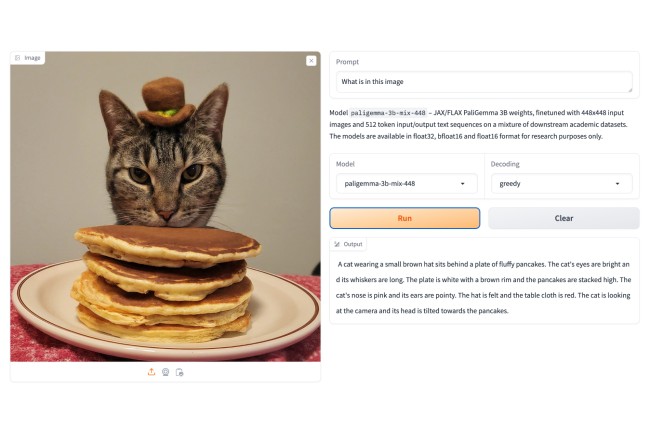

Más IA para Google. La firma aprovechó su conferencia I/O para enriquecer la oferta de Gemma LLM. De hecho, presentó el modelo de visión-lenguaje Paligemma. De código abierto, se inspiró en el modelo Pali-3, pero es más pequeño y rápido. Construido sobre componentes del modelo de visión SigLIP, PaliGemma está pensado para tareas de visión-lenguaje como subtítulos de imágenes y vídeos, respuesta visual a preguntas, comprensión de texto en imágenes, detección de objetos y segmentación. PaliGemma está disponible en GitHub, Hugging Face, Kaggle y Vertex AI.

Paligemma mejora el rendimiento de los modelos actuales de visión del lenguaje. (Crédito de la foto: Google)

El otro anuncio es una segunda versión de Gemma con 27 mil millones de parámetros, que se espera que se lance en las próximas semanas. "Con 27 mil millones de parámetros, Gemma 2 ofrece un rendimiento comparable al de Llama 3B con la mitad del tamaño", dijo Google. Este diseño eficiente reduce los costos de implementación, ya que Gemma 2 requiere menos de la mitad del cálculo para modelos comparables. Para el ajuste fino, Gemma 2 puede funcionar con soluciones como Google Desde la nube hasta herramientas como Axolotl.

Entre otras presentaciones de LLM, Google está mejorando su herramienta Responsible Generative AI (IA generativa responsable) al lanzar el servicio LLM Comparator como código abierto. Esta solución de visualización de datos interactiva permite a los desarrolladores evaluar modelos, lo que incluye realizar comprobaciones en paralelo de las respuestas de los modelos para evaluar su calidad y seguridad.

Con LLM Comparator, un desarrollador puede comparar resultados con diferentes modelos. (Crédito de la foto: Google)

Otras noticias que te pueden interesar