Opadai Finalmente se eleva Un poco antes el velo en su última generación de LLM. Hasta entonces conocido como el código de fresa, Se suponía que debía llegar dentro de una o dos semanas Pero en realidad es ahora que el proveedor estadounidense ha decidido tomar medidas presentando O1. Esta generación de modelos de lenguaje grande es característica de pasar más tiempo tratando las respuestas a las solicitudes con el propósito de resolver problemas difíciles. Se basa para esto en técnicas de cadenas de pensamiento con la clave de la capacidad de emular un razonamiento más complejo.

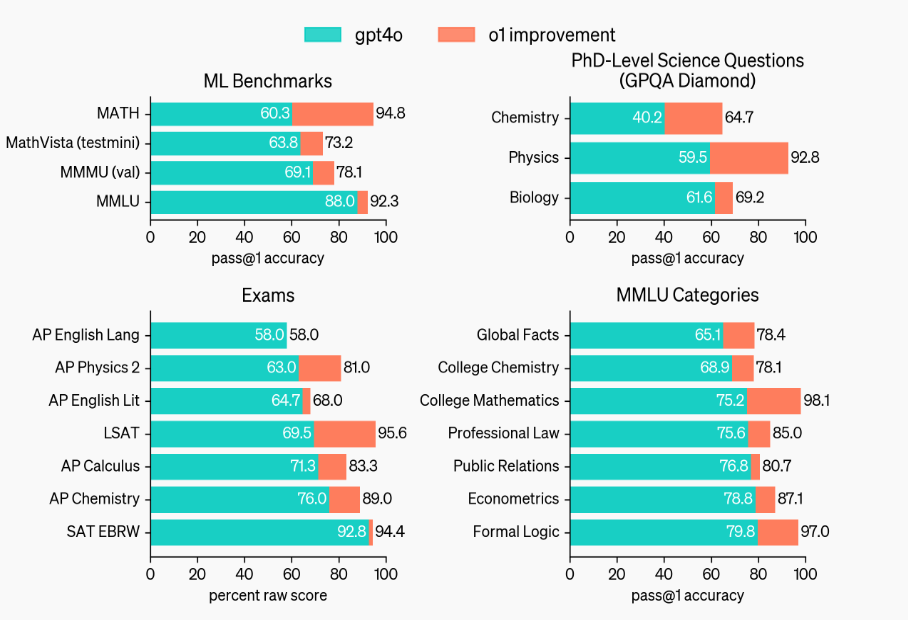

Para respaldar sus comentarios, Openai anunció que O1 se ubica en el percentil 89 para problemas de programación competitivos (CodeForces), entre los 500 mejores estudiantes en los Estados Unidos durante una prueba de calificación para las Olimpiadas de Matemáticas (AIM), y excede el nivel de precisión de un Doctorado Humano en un resumen de problemas de física, biología y química (GPQA). "Nuestro algoritmo de aprendizaje por un fortalecimiento a gran escala enseña al modelo a pensar de manera productiva utilizando su cadena de pensamiento como parte de un proceso de capacitación muy efectivo en términos de datos", dice la compañía. "Hemos descubierto que el rendimiento de O1 mejora constantemente con más aprendizaje mediante el fortalecimiento (cálculo del tiempo de entrenamiento) y con más tiempo dedicado a la reflexión (cálculo del tiempo de prueba)".

Salvaguardas en términos de valores y principios humanos

O1 mejora en comparación con GPT-4O en una amplia gama de puntos de referencia, incluidas 54/57 subcategorías MMLU. Siete de ellos se presentan como una ilustración. (Crédito: Openai)

Los usuarios de ChatGPT Plus y el equipo ya tienen acceso a la versión beta de esta LLM (O1-Preview) sabiendo que y O1-Mini también se lanza al mismo tiempo. Los usuarios de los planes Enterprise y EDU tendrán acceso a él a principios de la próxima semana. Operai Plane para dar O1-Mini a todos los usuarios gratuitos de ChatGPT, pero aún no ha establecido una fecha de lanzamiento. Para los desarrolladores, por otro lado, este LLM parece muy costoso: la previa vista O1 en modo API es de hecho $ 15 por 1 millón de tokens como iniciador, o textos de texto analizados, y $ 60 por 1 millón de tokens. A modo de comparación, GPT-4O cuesta $ 5 por 1 millón de tokens como titular y $ 15 por 1 millón de tokens.

Operai reconoce, sin embargo, que las restricciones vinculadas a la escala del enfoque utilizado para O1 difieren considerablemente de las del pre -aprendizaje de su LLM anterior y que continúa trabajando en ello. "Hemos encontrado que la integración de las políticas de comportamiento de nuestro modelo en la cadena de pensamiento de un modelo de razonamiento es un medio efectivo para enseñar de manera sólida los valores y principios humanos", también garantiza la sociedad. Un punto en el que el grupo es particularmente vigilante y en el que observa como leche en llamas con el riesgo de seguir siendo aprobado como aprendiz de orientación.

Otras noticias que te pueden interesar