Esta herramienta protege tus selfies del reconocimiento facial

hace 5 años

Un equipo de investigación de la Universidad de Chicago acaba de publicar una herramienta que tiene como objetivo ocultar tus fotos a los ojos de los algoritmos de reconocimiento facial. Una herramienta interesante y potencialmente muy poderosa, pero que probablemente tendrá dificultades para imponerse lo suficiente como para tener el impacto esperado ...

El reconocimiento facial está hoy en el centro de muchas controversias. Por un lado, es una tecnología fantástica con muchas aplicaciones del mundo real, como desbloquear su teléfono inteligente o su computadora de manera muy segura. Algunos laboratorios también están desarrollando sistemas para detectar señales de advertencia de ciertas enfermedades neurodegenerativas a partir de marcadores faciales. A mayor escala, también puede tener un interés de seguridad, por ejemplo, para interceptar a delincuentes con licencia. Pero a pesar de sus intereses potenciales, el reconocimiento facial global y generalizado también es reconocido como una de las principales amenazas potenciales en términos de privacidad y protección de datos personales.

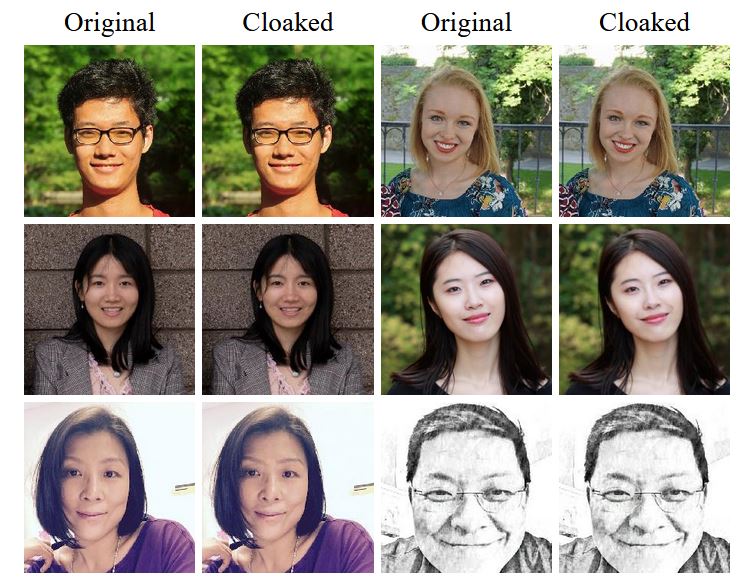

Evidentemente, el futuro de nuestras fotos en la Web plantea cada vez más preguntas, y es natural que ciertas organizaciones desarrollen soluciones para frenar este reconocimiento sistemático. Este es el caso de Fawkes, una herramienta desarrollada por científicos del SAND Lab de la Universidad de Chicago y descargable aquí, que utiliza inteligencia artificial para modificar tus fotos de formas muy sutiles. Pero esta no es una herramienta de retoque ya que las fotos así generadas son casi indistinguibles de las originales a primera vista ... al menos para un humano. ¡Porque estas alteraciones, por discretas que sean, hacen un trabajo extraordinario cuando se trata de engañar a los algoritmos de reconocimiento facial!

Un "camuflaje" contra el reconocimiento facial

El objetivo es simple: es proporcionar información contradictoria a los algoritmos de detección, muy a menudo construidos sobre la base de miles de millones de imágenes obtenidas de los cuatro rincones de la Web. Según los autores, si una imagen transmitida por Fawkes es "devorada" por un algoritmo de este tipo, asociará ese rostro ligeramente alterado con su identidad y, por lo tanto, en teoría, su rostro "real" no será reconocido. Una técnica que es un poco del caballo de Troya y ataca directamente la integridad de los conjuntos de datos de los que las IA no solo son aficionadas, sino que también dependen por completo. Y los resultados alegados por el equipo de investigación son poco creíbles ya que Fawkes ha logrado engañar a algunos de los mayores servicios del sector (Azure Face, Amazon Rekognition, Face ++ ..) con una eficiencia de… ¡100%! Fanfarronear.

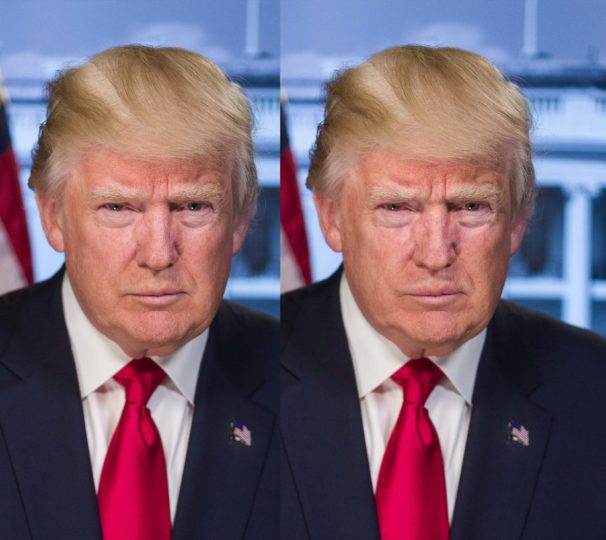

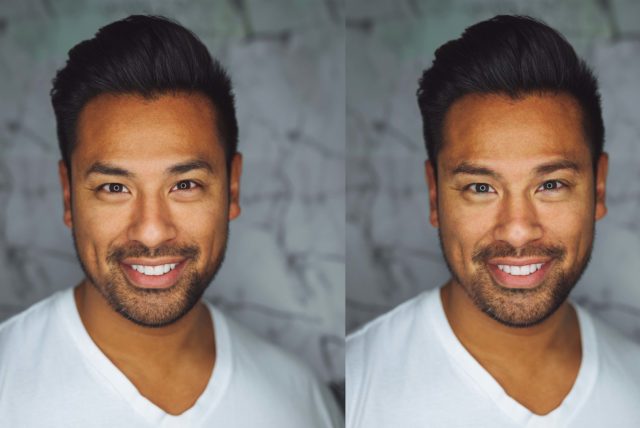

Sin embargo, en estos pocos ejemplos, notamos rápidamente que algo está mal en algunas fotos modificadas. Juzgue usted mismo: hicimos la prueba con el presidente de los Estados Unidos y dos personas anónimas encontradas en el sitio de fotografías libre de derechos Unsplash. Si la diferencia es realmente mínima en el contexto de los dos anónimos, sin embargo, la modificación se puede ver a primera vista en la foto de Donald Trump.

Según Ben Zhao, profesor de la Universidad de Chicago que participó en el proyecto, “Una vez que se ha producido esta corrupción, estás continuamente protegido, vayas donde vayas.”. Pero no podemos evitar tomar esta declaración con un grano de sal. En efecto, para imaginar corromper permanentemente las bases de datos de los principales servicios de reconocimiento facial, sin duda sería necesario regarlas con fotos modificadas con Fawkes, y esto implica que se utilice de forma extensiva, o incluso integrada por defecto en diversas aplicaciones o plataformas de intercambio. de la foto. Sin mencionar el hecho de que Internet ya está lleno de miles de millones de retratos en forma de píxeles, que los algoritmos de aprendizaje profundo ya he tenido mucho tiempo para devorar y digerir ...

El equipo de investigación dice que confían en la capacidad de su producto para impactar en los principales sistemas de reconocimiento facial, pero también admiten que ciertamente se necesitará un despliegue significativo para tener un impacto real. Para ello, el camino real parece listo: Fawkes tendría que integrarse de forma nativa en aplicaciones de fotografía o redes sociales como Facebook o Instagram, en cuyo caso sí podría tener el alcance necesario para actuar a gran escala. Aún queda por optimizar el algoritmo, que sigue siendo relativamente lento de momento (un minuto por foto en una máquina media) ... y convencer a los grandes reproductores digitales de que se apoderen de este sistema, que parece muy, muy lejos de llegar.

Si quieres conocer otros artículos parecidos a Esta herramienta protege tus selfies del reconocimiento facial puedes visitar la categoría Artículos.

Otras noticias que te pueden interesar