Sobre todo, no repitan el error de Microsoft con su El chatbot de Tay es tan vanguardista como racistaFrente a los cambios sociales en términos de representación y diversidad de género, Google La empresa de Mountain View se adelantó en no dejarlo fuera de los resultados de búsqueda de su herramienta de inteligencia artificial generativa Gemini. Pero, por querer hacerlo demasiado bien, la firma de Mountain View se vio atrapada en su propio juego al provocar inadvertidamente una reinterpretación histórica al mostrar en sus resultados de búsqueda personajes -ciertamente ficticios- pero cuya presencia es sencillamente imposible.

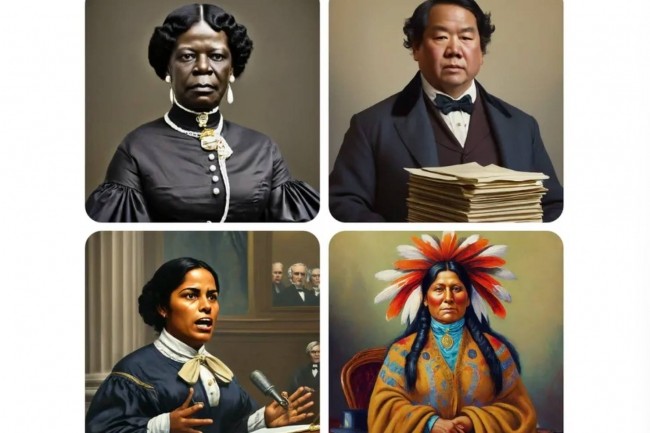

En respuesta a las consultas para generar un papa, un rey inglés medieval, un vikingo, un senador estadounidense del siglo XIX o un soldado alemán de 1943, Gemini arrojó resultados históricamente inexactos tanto con mujeres como con personas de raza negra. "Somos conscientes de que Gemini proporciona imprecisiones en algunas representaciones históricas de la generación de imágenes", Google dijo“Estamos trabajando para mejorar este tipo de representaciones. La generación de imágenes con inteligencia artificial de Gemini genera una amplia gama de personas, y eso es, en general, una buena idea porque la utilizan personas de todo el mundo, pero en este caso no da en el blanco”.

A principios de esta semana, un ex empleado de Google a cargo de la búsqueda publicado en X que era “terriblemente difícil conseguir que Google Gemini admitiera que existen personas blancas”, al mostrar una serie de consultas como “generar una imagen de una mujer australiana” cuyos 4 resultados mostraban mujeres no blancas. Lo cual no es del todo absurdo, teniendo en cuenta la población aborigen nativa.

Otras noticias que te pueden interesar