Según una encuesta de la firma consultora Deloitte, casi el 15 % de los gerentes dicen que los ciberdelincuentes han atacado sus datos financieros o contables utilizando profundos al menos una vez durante el año pasado. El 11 % incluso confirma haber sido víctimas de varias estafas de este tipo. Estas técnicas de falsificación de IA de imágenes, sonidos, videos o cualquier tipo de datos han sido durante mucho tiempo una pesadilla reservada para personalidades de política o espectáculo. Las respuestas a la encuesta de Deloitte confirman que ahora también se dirigen a las empresas.

Además del riesgo cibernético, la situación también implica riesgos financieros. No solo se preocupa que los CIO y RSSI, sino también la gestión de riesgos. La agencia de calificación Moody's también publicó en la primavera una advertencia confirmándolo específico. El informe detalla algunos intentos de estafar por Deepfake, incluidas las videollamadas falsas, que se han dirigido al sector financiero en los últimos dos años. "Se pueden utilizar profundos para crear videos fraudulentos de gerentes en bancos, gerentes de negocios o funcionarios para redirigir transacciones financieras o realizar pagos fraudulentos", dijo el documento. Versiones mucho más sofisticadas y variadas que el buen fraude telefónico viejo para el presidente.

Un nuevo campo de posibilidades para los piratas

La encuesta de Deloitte se realizó con más de 1.100 líderes empresariales durante un seminario web en mayo sobre la confianza en la IA generativa. Alrededor de la mitad de los que no han respondido que han notado un ataque de Deepfake, digamos que no se sienten preocupados o no saben si su organización ha sido atacada. Por lo tanto, puede ser que todas las organizaciones verdaderamente específicas no sean declaradas, como Michael Bondar, el líder del Trust Global Enterprise especifica en Deloitte, porque las estafas de Deepfake en los datos financieros aún son relativamente recientes. "Cuando ocurren tales incidentes, las organizaciones no están dispuestas a jactarse de ello", agrega. En realidad, estamos hablando de una nueva extensión de nuevas posibilidades ”.

Más de la mitad de los cuestionados esperan que el número de estafas financieras de Deepfake aumente durante el próximo año. Para luchar contra este fenómeno, por el momento, se contentan con comunicarse con sus empleados, ofrecerles capacitación, desplegar nuevas políticas de protección o nuevas tecnologías. Pero alrededor del 10 % dice que su negocio no hace nada y casi un tercero no sabe lo que establece o no se siente preocupado.

Deepfakes sofisticados y documentados

"Deepfake de llamadas de voz es cada vez más común, pero ahora también se preocupa la videoconferencia", como especifica Mike Weil, líder de Forensics digitales y director gerente de Deloitte Advisory Services. La versión Deepfake del fraude al presidente. "Trae la ingeniería social a un nivel superior. Por un lado, hablas con esta persona, pero por otro lado, tiene mucha información que crees que es la única que los conoce. Los piratas pueden interactuar con usted de una manera que parece completamente legítima".

"Estos son ataques altamente coordinados y sofisticados, preparados aguas arriba con la recopilación de información sobre su organización o sus clientes", continúa Mike Weil. Estos no son ataques aleatorios. Por el contrario, se dirigen específicamente a puntos débiles dentro de la organización. Y el objetivo es obtener grandes sumas de dinero. "

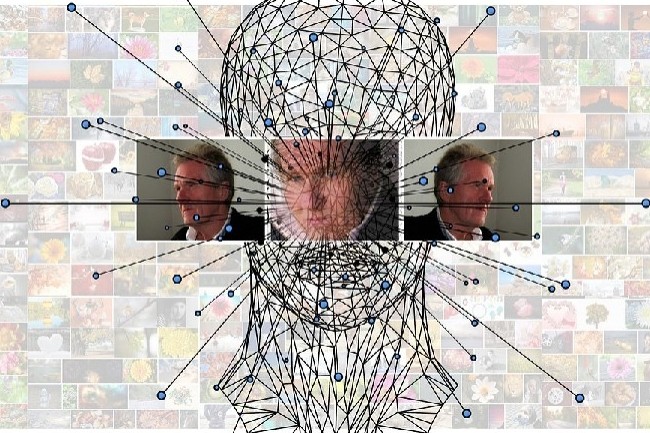

Participantes falsos de visioconferencia

Para Deloitte, para protegerse contra estos ataques de Deepfake, es necesario clásicamente educar y capacitar a los empleados, y garantizar que la gerencia siga escrupulosamente los procesos internos para la transferencia de grandes sumas de dinero, por ejemplo. Sin olvidar los ejercicios internos para verificar si los empleados pueden caer en este tipo de trampa.

En cuanto a las soluciones de detección de Deepfake, sus editores también usan IA para contrarrestar los métodos de los piratas informáticos.

Una carrera armamentista clásica en esta área en la encrucijada de la ciberseguridad y la IA. Para Kevin Surace, AppVance CTO, suministro de provisión de herramientas de software impulsado por AI, "cualquiera que hoy hoy pueda crear un mensaje de voz de Deepfake sin ninguna habilidad". Pero insiste en el aumento en la frecuencia de las llamadas vocales interactivas de Deepfake e incluso las intervenciones de los falsos participantes en videollamadas, incluso si esto requiere más conocimiento técnico. Fuertes métodos de crecimiento que, según él, han explotado a fines de 2025.

Otras noticias que te pueden interesar