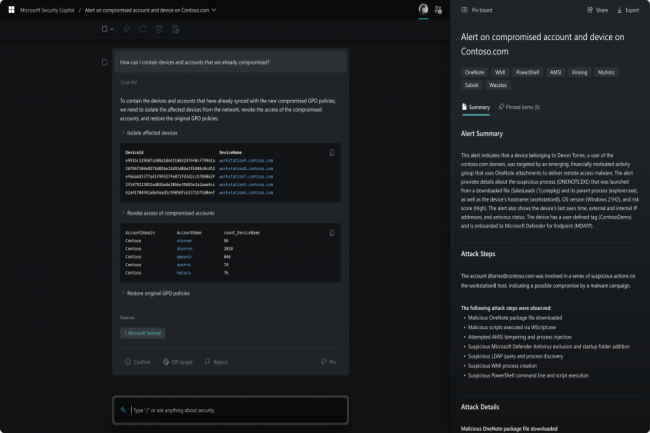

Después de Teams, la suite Microsoft365, es el turno de las soluciones de seguridad de la empresa de incorporar la IA generativa de OpenAI. Acaba de levantar el velo sobre Security Copilot, que ofrece multitud de funciones y análisis. Su interfaz es similar a ChatGPT y puede responder preguntas sobre seguridad informática de forma natural. Pero lo más impresionante es la estrecha integración con los diversos servicios de seguridad de Microsoft, incluidos Defender, Sentinel, Entra, Purview, Priva e Intune.

Copilot puede interpretar datos de todos estos servicios y proporcionar explicaciones detalladas y automatizadas (incluidas visualizaciones), así como sugerir soluciones. Además, el sistema podrá tomar medidas contra ciertos tipos de amenazas, por ejemplo, eliminando mensajes de correo electrónico cuyo contenido malicioso haya sido identificado durante un análisis anterior. Microsoft planea expandir las capacidades de Security Copilot más allá de sus propios productos, pero el proveedor no ha dado más detalles al respecto, ni en su comunicación ni en su comunicado. en la publicación del blog oficial en el servicio. Microsoft también señaló que, como producto de IA generativa, Security Copilot no dará respuestas 100% correctas y necesitará capacitación y aportes adicionales de los primeros usuarios para alcanzar su máximo potencial.

Datos cibernéticos para el entrenamiento de IA, un tema delicado

Según los expertos en IA, aunque no es tan innovador como lo presentó Microsoft, Security Copilot es un sistema poderoso. Según Avivah Litan, vicepresidente y analista de Gartner, IBM ha tenido capacidades similares a través de Watson AI durante años. "La IA de Copilot es más rápida y mejor, pero la funcionalidad es la misma", afirmó. “Es una oferta interesante, pero no resuelve los problemas que tienen los usuarios con la IA generativa. Independientemente de estos problemas, el más importante de los cuales es la reconocida incapacidad de Security Copilot para proporcionar información precisa en todos los casos, los beneficios potenciales del sistema siguen siendo impresionantes", afirmó Chris Kissel, vicepresidente de búsqueda de IDC. "La gran ventaja es que puedes automatizar muchas más cosas”, dijo. “La idea de que un ChatGPT pueda escribir algo dinámicamente y el análisis pueda juzgarlo en contexto, en la misma capa, es convincente”, agregó.

Ambos analistas, sin embargo, se mostraron algo escépticos sobre la política de intercambio de datos de Microsoft, en particular que los datos privados no se utilizarán para entrenar modelos centrales de IA y que toda la información del usuario permanecerá bajo su control. El problema, dicen, es que los datos de incidentes son clave para entrenar modelos de IA como el utilizado para Security Copilot, y la compañía no ha dado mucha orientación sobre cómo se procesarán esos datos. "Es preocupante", dijo Kissel. “Si intentamos hacer algo que involucra, por ejemplo, una pieza específica de propiedad intelectual, ¿hay alguna garantía de que esos datos se mantendrán en su lugar? “, preguntó. “¿Cómo se puede saber si los datos están realmente protegidos si no proporcionan las herramientas para revisarlos”, añadió Avivah Litan. Hasta el momento, Microsoft no ha anunciado una fecha de disponibilidad para Security Copilot, pero el proveedor dijo que pronto compartirá más información al respecto.

Otras noticias que te pueden interesar