En medio del auge de la IA, Manzana Se le suele señalar con frecuencia por llegar tarde. Sin embargo, la firma de Cupertino está trabajando seriamente en el tema para mejorar las respuestas de su asistente de voz Siri. Esto es lo que se desprende Trabajo de investigadores de la empresa Desarrollando un sistema de inteligencia artificial que pueda entender referencias ambiguas y el contexto de la conversación. Por ejemplo, cuando se le pide que busque una farmacia cerca de usted, el asistente proporcionará una lista y luego la persona preguntará "llame a la que está en Rainbow Road" o "llame a la de abajo" o "llame a este número". Estos "este" y "este" son difíciles de entender para un asistente de voz.

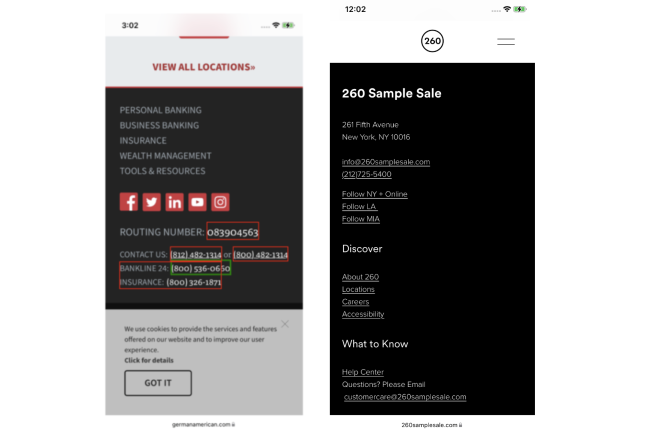

El servicio, denominado ReALM (Reference Resolution As Language Modeling), aprovecha los LLM para convertir la compleja tarea de resolver referencias, incluso en imágenes, en un problema de modelado del lenguaje. En términos concretos, la herramienta descompone la imagen en la pantalla en pequeñas entidades para generar una representación textual mediante la captura del diseño visual. Los investigadores demostraron que este enfoque, combinado con el ajuste fino de los LLM específicos para la resolución de referencias, superó a GPT-4 en esta tarea.

Modelos más pequeños y potentes

El LLM de OpenAI se basa en el análisis de imágenes para comprender la información que se muestra en la pantalla. “La mayoría de los datos de entrenamiento de imágenes se basan en imágenes naturales, no en páginas web codificadas artificialmente llenas de texto, por lo que el OCR directo es menos efectivo”, señalan los investigadores. Apple descubrió que sus modelos ReALM más pequeños (80 millones, 250 millones, 1.000 millones y 3.000 millones de parámetros) funcionaron de manera similar a GPT-4, lo que los hace más adecuados para su uso en un dispositivo móvil.

Por ejemplo, si estás navegando por una web y decides llamar a la empresa, con solo decir "llamar a la empresa" Siri tendrá que analizar lo que quieres decir en función del contexto. Será capaz de "ver" que en la página hay un número de teléfono que está etiquetado como de la empresa y llamar sin necesidad de que el usuario lo pida. Esta dirección demuestra que la firma estadounidense sigue invirtiendo en su asistente de voz Siri. Se espera que Apple presente varias innovaciones de IA en iOS 18 en la conferencia para desarrolladores WWDC que tendrá lugar del 10 al 14 de junio.

Otras noticias que te pueden interesar