Después de Openai y Google, AI Mistral Hizo sus primeros pasos en LLM multimodal. La nueva empresa francesa acaba de lanzar discretamente un modelo llamado PixTral 12B que puede analizar texto e imágenes. Como su nombre lo indica, el LLM utiliza aproximadamente 12 mil millones de parámetros y tiene capacidad de reconocimiento de imágenes (visión por computadora).

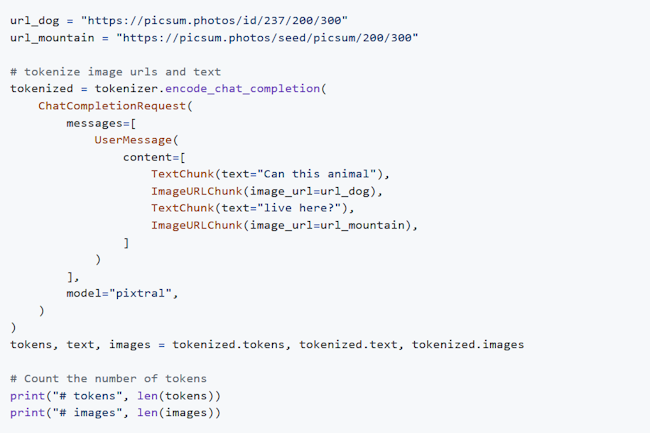

PixTral 12B se desarrolló sobre la base de Nemo 12B, un modelo antiguo al que la compañía ha trasplantado un adaptador de visión por computadora de 400 millones de parámetros. Este último permite a los usuarios agregar imágenes a través de URL o codificarlas a través de Base64 en el texto ingresado. Por lo tanto, al modelo presentado debería gustarle sus contrapartes Claude d'Anthrope, GPT-4O de OpenAi o Géminis de Google que pueden realizar tareas como imágenes de leyenda y contar el número de objetos en una foto.

Un modelo de código abierto

La compañía ha publicado los parámetros y código PixTral 12B a través de un enlace de torrent en GitHub y la plataforma de alojamiento de código y intercambio de código en Hugging Face. Ella confirmó a Nuestros colegas de TechCrunch que el modelo está disponible bajo la licencia Apache 2.0 sin ninguna restricción. Por lo tanto, los desarrolladores pueden refinarlo y capacitarlo de acuerdo con sus propias necesidades. Sophia Yang, directora de relaciones con los desarrolladores de Mistral, dijo En un mensaje en x que el modelo pronto estaría disponible para ser probado en las plataformas de chatbot y la API Mistral, Le chat y la plataforma.

Otras noticias que te pueden interesar