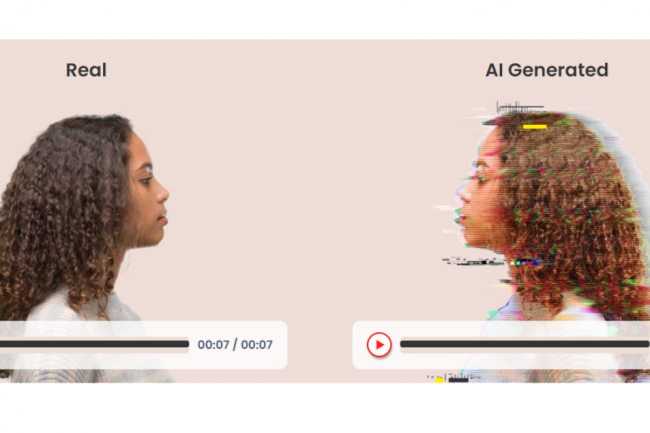

Tanto la oportunidad como la amenaza. Si bien los casos de uso que involucran la IA en todas sus formas se multiplican y sus promotores nunca dejan de resaltar sus beneficios, esta tecnología también puede ser mal utilizada. Este es precisamente el caso de los deep fakes, que consisten en generar tanto vídeos como mensajes de audio imitando un modelo humano hasta tal punto que resulta muy difícil -si no imposible- detectar lo real de lo falso. Para intentar proteger a los usuarios de la suplantación de voz por parte de los piratas informáticos, McAfee está contribuyendo con su tecnología de detección de audio deepfake, también conocida como Mockingbird.

Aún en forma de borrador, y un guiño al programa de la CIA para influir en los medios y la opinión pública en la década de 1960, Mockingbird "fue desarrollado para ayudar a defender a los consumidores contra la creciente amenaza de los ciberdelincuentes que utilizan sonidos generados por IA para llevar a cabo estafas que roban dinero y información personal, permitir el acoso cibernético y manipular la imagen pública de figuras importantes”. explicar el proveedor de seguridad. “Las herramientas de IA generativa, cada vez más sofisticadas y accesibles, han facilitado a los ciberdelincuentes la creación de estafas muy convincentes, como el uso de la clonación de voz para hacerse pasar por un miembro de la familia en apuros y pedirle dinero. Otros, a menudo llamados cheapfakes, pueden implicar la manipulación de videos auténticos, como noticias de televisión o entrevistas con celebridades, insertando audio falso para alterar las palabras que salen de la boca de alguien; da la impresión de que una persona conocida o de confianza dijo algo diferente a lo que se dijo originalmente”.

Varios temores de apropiación indebida

Anunciada en CES 2024 (9-12 de enero de 2024), la tecnología de detección de audio deepfake de McAfee aún no se ha detallado, pero tendría una precisión superior al 90%. Según un último estudio del editor de diciembre de 2023 sobre los deepfakes, el 84% de los estadounidenses están preocupados por cómo se utilizarán en 2024 y, en particular, el 57% por la proliferación de estafas. El uso de deepfakes para el ciberacoso preocupa al 44% de los estadounidenses y más de la mitad (52%) teme que su aumento influya en las elecciones, reduzca la confianza del público en los medios (48%) y se utilice para suplantar la identidad de figuras públicas (49%). . En mayo pasado, McAfee presentó un estudio global sobre los avances de la IA utilizada en ciberataques y en el proceso mostró un ejemplo revelador de la Dificultad para un humano no dejarse engañar por un audio deepfake.

Otras noticias que te pueden interesar