Anunciado en la conferencia anual con: Invent organizado esta semana (del 2 al 6 de diciembre) por AWS, las características de Bedrock deben ayudar a las empresas a racionalizar las pruebas de aplicación de IA antes de su implementación. La actualización incluye una herramienta de evaluación RAG (recuperación aumentada o generación aumentada de recuperación) dentro de las bases de conocimiento generalmente utilizadas por las empresas para usar sus propios datos para proporcionar más contexto para LLM y obtener mejores respuestas de ellos. Las empresas también pueden usarlo para implementar todo el flujo de trapo de una aplicación, desde la ingestión hasta la extracción y la mayor demanda, sin tener que construir integraciones personalizadas de acuerdo con las fuentes de datos y administrar los flujos de datos.

"Ahora es posible llevar a cabo una evaluación automática de la base de conocimiento para evaluar y optimizar las aplicaciones de RAG utilizando las bases de conocimiento", escribió el proveedor en una publicación de blog, y agregó que el proceso de evaluación involucró una LLM para el cálculo de las métricas de evaluación. Según AWS, las evaluaciones de RAG conducen a comparar diferentes configuraciones y ajustar sus parámetros para obtener los resultados que necesitan para su caso de uso. "Para llevar a cabo estas evaluaciones, los usuarios pueden pasar por la consola de roca y elegir" evaluaciones "después de navegar en la consola" Sección de inferencia y evaluación "", dijo la compañía. Esta característica está actualmente disponible en la vista previa.

Conectores personalizados

AWS También anunció el apoyo de conectores personalizados y la posibilidad de reclasificar los modelos en bases de conocimiento. Los conectores facilitan la ingestión de datos de diversas fuentes, incluida la continua en las bases de conocimiento en el lecho de roca. "Los desarrolladores ahora pueden ingerir, actualizar o eliminar datos de manera efectiva y rentable de una sola llamada API, sin tener que hacer una sincronización completa con la fuente de datos periódicamente o después de cada cambio", dijo el proveedor. Sin este soporte de conectores personalizados, las empresas deben trasladar sus datos a una fuente respaldada por AWS, como S3. Estos componentes están disponibles y se pueden acceder a través de la consola Bedrock y el Kit de desarrollo de software AWS (SDK).

Además, AWS introdujo la API Rerank en las bases de conocimiento. Gracias a esta herramienta, los desarrolladores pueden usar modelos de reclasificación dinámica, o volver a hacer para hacer que sus aplicaciones se basen en RAG sean más eficientes. Esto mejora la relevancia y precisión de las respuestas y reduce los costos. Según AWS, los modelos de reclasificación dinámica accesibles a través de la nueva API podrían ayudar a los desarrolladores a superar los límites de la investigación semántica, que a menudo interviene en las aplicaciones de RAG. La incapacidad de priorizar los documentos más apropiados de acuerdo con las preferencias del usuario o el contexto de la solicitud, en particular cuando la solicitud es compleja, ambigua o que implica un contexto matizado, es uno de estos límites. "Esto puede conducir a la recuperación de documentos que solo son parcialmente relevantes en relación con la pregunta del usuario", dijo la compañía, y agregó que la recuperación de documentos parcialmente relevantes puede plantear otro desafío vinculado a la asignación correcta de fuentes. Hasta la fecha, la API admite los modelos Amazon Rerank 1.0 y Cohere Rerank 3.5.

Un LLM-as-a-Judge en la evaluación del modelo de roca madre

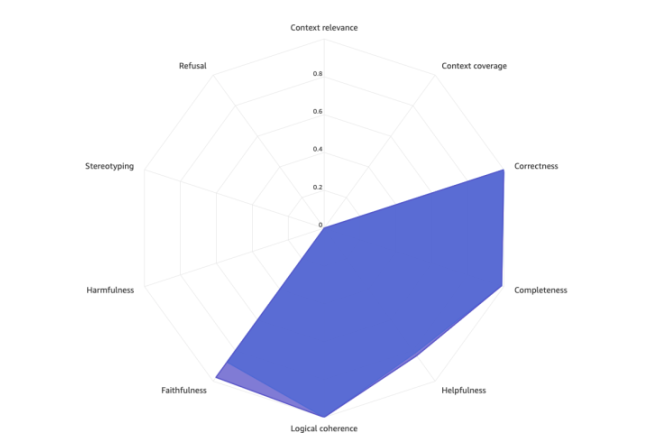

El proveedor de la nube también ha agregado la funcionalidad del referente de LLM "LLM-AA-Judge" al modelo de evaluación de roca madre. Esta herramienta de evaluación puede ayudar a las empresas a elegir un LLM que corresponde a su caso de uso. La funcionalidad LLM-AA-Judge, actualmente disponible en la vista previa, brindará a los desarrolladores la capacidad de realizar pruebas y evaluar otros modelos con calidad similar a la de un humano, a un costo más bajo que el de un humano. "Gracias a LLM-As-A-Judge, las empresas pueden pasar más fácilmente a la producción al proporcionar una evaluación rápida y automatizada de las aplicaciones de IA, acortando los bucles de retroalimentación y las mejoras aceleradas", dijo AWS. Las evaluaciones se relacionan con varios aspectos cualitativos, en particular la precisión, la utilidad y los criterios de la IA responsable, como el rechazo de la respuesta y la daños.

Otras noticias que te pueden interesar