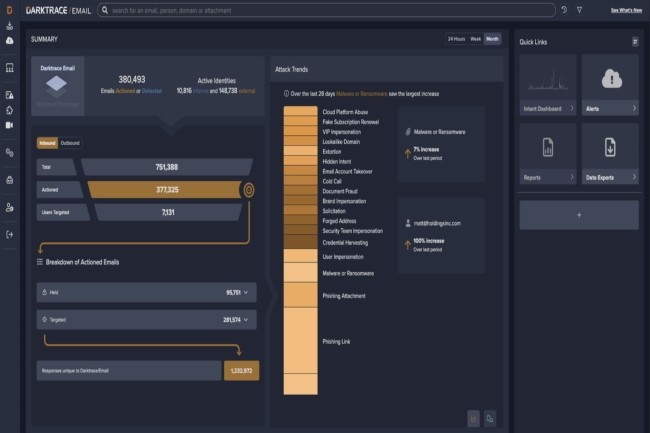

Los editores de ciberseguridad se están poniendo en marcha ante el aumento de la IA generativa. Estos últimos, diseñados en un marco pacífico, también pueden ayudar a los ciberdelincuentes a mejorar sus ataques. En respuesta a esta tendencia, Darktrace acaba de actualizar su producto de correo electrónico con características como un bucle de retroalimentación, protección contra apropiación de cuentas, información de puntos finales, red y nube, así como detecciones de comportamiento en correos electrónicos mal dirigidos.

Aprender sobre el comportamiento empresarial normal

"La función Cyber AI Loop puede detectar ataques tan pronto como se lanzan", dijo la compañía en un comunicado. De hecho, según Darktrace, la herramienta no se entrena sobre la base de ataques pasados y comportamientos “maliciosos” históricos, sino que aprende los patrones de comportamiento normales de cada empresa. Esta característica es esencial para combatir ataques de correo electrónico recientes y comunicaciones maliciosas lingüísticamente complejas impulsadas por tecnologías de inteligencia artificial como ChatGPT y LLM.

Según el editor, su solución es capaz de detectar estos sofisticados ataques de correo electrónico 13 días antes (en promedio) que otras herramientas entrenadas en el conocimiento de amenazas pasadas. "En esta actualización, Cyber AI Analyst combina la actividad anómala del correo electrónico con otras fuentes de datos, incluidos endpoints, redes, nubes, aplicaciones y OT, para automatizar investigaciones e informes de incidentes", dijo la firma. Según ella, “con esta contextualización más amplia en torno a sus hallazgos, la IA de Darktrace ahora puede tomar decisiones más informadas, y los algoritmos proporcionan una imagen detallada de la “normalidad” basada en múltiples perspectivas para producir conclusiones confiables, contextualizadas y explotables.

Otras características de Darktrace/Email incluyen protección combinada de adquisición de cuentas y de correo electrónico en un solo producto. Asimismo, detección comportamental de correos electrónicos mal dirigidos, para evitar que propiedad intelectual o información confidencial se envíe a destinatario equivocado. Además, incluye una gestión más precisa para combatir mejor el correo gris, el spam y los boletines que saturan las bandejas de entrada. La herramienta también incluye investigaciones automatizadas sobre incidentes relacionados con el correo electrónico.

Los ataques de correo electrónico generados por ChatGPT avanzan

Desde el lanzamiento de ChatGPT por parte de OpenAI el año pasado, ha habido mucho debate y preocupación sobre la capacidad del chatbot para hacer que los ataques de ingeniería social/phishing sean más sofisticados, más fáciles de llevar a cabo y con más probabilidades de tener éxito. Según datos de DarktraceDe enero a febrero de 2023, los ataques de ingeniería social contra miles de sus clientes activos aumentaron un 135 %, en consonancia con la adopción masiva de ChatGPT. "Estos ataques implican el uso de técnicas lingüísticas sofisticadas, incluido el aumento del volumen del texto, la puntuación y la longitud de las oraciones", dijo el proveedor. Además, al 82% de los 6.711 empleados globales encuestados por Darktrace les preocupa que los atacantes aprovechen la IA generativa para crear correos electrónicos fraudulentos que no se pueden distinguir de una comunicación genuina.

La semana pasada, Europol advirtió sobre la capacidad de ChatGPT para escribir textos muy realistashaciéndolo muy útil para el phishing. Además, la capacidad de los LLM para reproducir modos de expresión se puede utilizar para imitar el estilo de habla de individuos o grupos específicos. "Esta capacidad puede explotarse a gran escala para engañar a víctimas potenciales y hacerles confiar en actores criminales", dijo Europol. En febrero, una encuesta de BlackBerry realizada a 500 tomadores de decisiones de TI del Reino Unido encontró que el 72% estaba preocupado por el posible uso malicioso de ChatGPT. La mayoría de ellos cree que los estados extranjeros ya están utilizando el asistente de chat contra otras naciones. Además, el 48% de los encuestados cree que en los próximos 12 meses ChatGPT se verá involucrado en un ciberataque exitoso, y el 88% cree que corresponde a los gobiernos regular tecnologías avanzadas como ChatGPT.

Otras noticias que te pueden interesar